Scientific journal

Modern high technologies

ISSN 1812-7320

"Перечень" ВАК

ИФ РИНЦ = 1,279

METHOD FOR CLASSIFICATION OF OBJECTS OF THE VIRTUAL ADAPTATION SPACE

В настоящее время информационные технологии охватывают широкий спектр сфер деятельности человека. Большую роль в задаче информатизации производства занимают работы, связанные с разработкой цифровых двойников производственных процессов. Под цифровым двойником производственного процесса следует понимать компьютерную копию физического объекта или процесса, погруженного в среду имитационного моделирования. Среда имитационного моделирования создает виртуальное пространство, позволяющее исследователю взаимодействовать с цифровой копией объекта. Таким образом, задача создания цифрового двойника разбивается на два этапа, включающих этап создания имитационной среды и этап построения математической модели.

Изначально для визуализации окружающего пространства прибегали к концепции виртуальной реальности, которая предполагает полное погружение исследователя в виртуальный мир и моделирование всех видов взаимодействия с искусственным миром. Основным недостатком концепции виртуальной реальности является высокая сложность задачи моделирования взаимодействия исследователя с виртуальными объектами [1].

Следующим этапом эволюции систем для моделирования виртуального пространства стало появление систем дополненной реальности. Системы дополненной реальности реализуют гибридный подход, основанный на заимствовании физического взаимодействия исследователя с окружающим миром и расширения такого взаимодействия через внедрение компьютерных виртуальных моделей в визуальный канал восприятия исследователя.

Новым витком эволюции систем дополненной реальности стало появление систем виртуального адаптационного пространства. Виртуальное адаптационное пространство (ВАП) – воспринимаемая смешанная реальность, созданная путем введения в каналы восприятия сенсорных данных с целью компенсации поврежденных каналов восприятия субъекта виртуальной реальности [1]. Конкурирующей технологией для ВАП является кибернетической глаз Argus II [2]. Главное преимущество ВАП над Argus II заключается в отсутствии хирургического вмешательства. Основное преимущество систем ВАП над системами дополненной реальности заключается в комплексной активации нескольких каналов восприятия исследователя для динамической сбалансированной нагрузки на каждый канал восприятия [3, 4].

Особым преимуществом систем виртуального адаптационного пространства над остальными методами виртуализации является его компенсаторное влияние на каналы восприятия человека, когда один из каналов поврежден или слабо функционирует. Для взаимодействия человека с виртуальным пространством система виртуального адаптационного пространства использует датчики, которые осуществляют запись входного потока визуальной информации, а также осуществляют вывод данных с использованием средств для воспроизведения акустического сигнала.

В статье представлен пример погружения суперпозиции объектов физического пространства в виртуальное адаптационное виртуальное пространство и метод классификации объектов в виртуальном адаптационном пространстве.

Цель исследования заключается в проверке адекватности метода классификации объектов в виртуальном адаптационном пространстве.

Задачи исследования:

- построение виртуального адаптационного пространства;

- сегментация виртуального адаптационного пространства;

- выделение и погружение объектов в виртуальное адаптационное пространство;

- классификация объектов виртуального адаптационного пространства;

- верификация метода классификации объектов.

Материалы и методы исследования

Для погружения объектов в виртуальное пространство система виртуального адаптационного пространства использует принцип оптического параллакса.

В качестве верификационного базиса виртуального адаптационного пространства была выбрана сцена объектов, которые различаются по ряду характерных признаков (форма, размера, освещенность и т.д.).

Следует учитывать, что процедура погружения объектов окружающего пространства должна выявлять и подавлять шумы на сцене объектов. В качестве таких шумов можно рассматривать совокупность небольших объектов, обладающих критически маленьким объемом для погружения в виртуальное пространство. В качестве второго примера шума может выступать пестрая текстура средних и крупных объектов виртуального пространства.

На рис. 1 представлена пара снимков сцены объектов, которые были получены с мультимедийных датчиков системы виртуального адаптационного пространства. Датчики системы расположены в горизонтальной плоскости на небольшом расстоянии друг от друга. Поэтому левое и правое изображение описывает одну сцену с небольшим отклонением в левую и правую сторону в зависимости от положения датчика. Пара снимков необходима для дальнейшей обработки методом классификации объектов ВАП.

Рис. 1. Фотоснимки левой и правой части сцены объектов

Описание объектов сцены

|

№ |

Объект |

Форма |

Положение |

Z[м] |

R |

|

1 |

Штанга |

Цилиндр |

Низ сцены |

0,12 |

7,75 |

|

2 |

Пол |

Плоскость |

Центр сцены |

– |

– |

|

3 |

Виток черного провода |

Линия |

Левый край сцены |

0,45 |

2,07 |

|

4 |

Передняя ножка стула |

Параллелепипед |

Левый край сцены |

0,51 |

1,82 |

|

5 |

Коробка 3D ручки |

Параллелепипед |

Правый край сцены |

0,47 |

1,98 |

|

6 |

Коробка инструментов |

Параллелепипед |

Правый край сцены |

0,46 |

2,02 |

|

7 |

Коробки с топливом 3D принтера |

Параллелепипед |

Левый край сцены |

0,65 |

1,43 |

|

8 |

Виток красной пластмассы |

Линия |

Левый край сцены |

0,69 |

1,35 |

|

9 |

Мяч |

Шар |

Центр сцены |

0,73 |

1,27 |

|

10 |

Упаковка с тонером принтера |

Параллелепипед |

Левый край сцены |

0,86 |

1,08 |

|

11 |

Задняя ножка стула |

Параллелепипед |

Центр сцены |

0,9 |

1,03 |

|

12 |

Стена |

Плоскость |

Центр сцены |

0,93 |

1 |

|

13 |

Тень объектов |

Текстура |

Рядом с объектами |

– |

– |

В таблице приведен состав объектов сцены, включающий краткое описание объекта, его форму, пространственное расположение, расстояние от наблюдателя Z и обратное расстояние от самого удаленного объекта Ri = Zi/max(Z).

На первом этапе метода классификации объектов ВАП при погружении объектов в виртуальное пространство используется метод расчета оптического параллакса, который позволяет восстановить форму наблюдаемых объектов, учитывая инвариантность пропорций наблюдаемых объектов относительно местоположения наблюдателя [5].

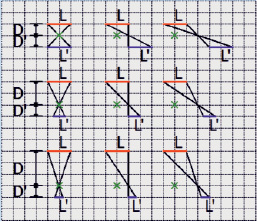

На рис. 2 представлена серия экспериментов по вычислению размеров объекта L в 2D пространстве. L – наблюдаемый объект. L' – образ объекта L в виртуальном пространстве. D – расстояние между наблюдаемым объектом и линзой камеры. D' – расстояние между линзой камеры и контактной матрицей мультимедийной камеры.

Рис. 2. Серия экспериментов по вычислению исходных размеров 2D объекта L

На представленном выше рисунке зеленым крестом обозначено исходное местоположение линзы камеры мультимедийных датчиков системы виртуального адаптационного пространства. В представленной серии экспериментов рассматриваются 3 варианта дистанций между объектом и его проекцией, в каждом из вариантов положение линзы смещается вправо на одну клетку.

Согласно правилу вычисления оптического параллакса между объектом и его проекцией сохраняются пропорции отношений между размерами объектами и расстояниями от объектов до линзы оптических устройств.

По известным параметрам L', D' и коэффициенту уменьшения оптического прибора можно вычислить неизвестные параметры L и D.

Исходя из инвариантности осей прямоугольной системы координат, можно сделать вывод, что все правила по вычислению размеров в 2D пространстве применяются схожим образом и для 3D пространства.

Наиболее сложной проблемой в системе виртуального адаптационного пространства является проблема обнаружения объектов в окружающем пространстве (проблема обнаружения и распознавания образов ОРО). Сложность решения проблемы ОРО в общем случае сопоставима со сложностью проблемы создания систем искусственного интеллекта. Из общего курса анатомии известно, что биологическим сенсором визуальной информации является глаз биологического объекта. Глаз снабжен чувствительной сетчаткой, в которой присутствуют чувствительные элементы: палочки и колбочки. Палочки сетчатки собирают информацию об интенсивности цвета окружающих объектов, а колбочки – о самом цвете объектов.

Подобно биологическому глазу датчики виртуального адаптационного пространства в первую очередь ориентируются на интенсивность отраженного света от окружающих объектов, а сам цвет объекта выступает вторичным признаком.

На втором этапе метода классификации объектов ВАП выполняется сегментация фотоснимков, которая заключается в разбиении исходного изображения по ширине w и высоте h на n сегментов и последующей обработке каждого сегмента. Изображение внутри каждого сегмента проецируется из цветового пространства RGB (соответствующего первоначальному цветному изображению) на ось Y цветового пространства YCbCr, в котором Y соответствует интенсивности цвета пикселя сегмента.

Операция выделения объектов в виртуальном адаптационном пространстве сводится к операции поиска пикселя с максимальным значением интенсивности Yij в каждом сегменте. Следующая итерация выделения объектов заключается в поиске области однотонных пикселей вокруг пикселя с интенсивностью Yij и выделении граничных точек на каждой из областей.

Финальная итерация выделения объектов заключается в объединении границ однотонных объектов, расположенных на соседних сегментах изображения. Таким образом, множество объектов виртуального адаптационного пространства формируется из множества границ однотонных объектов на исходном изображении.

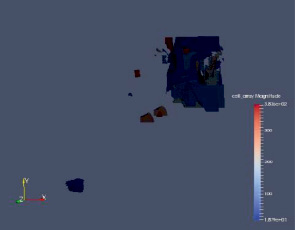

На рис. 3 представлены варианты границ объектов полученных при обработке фотоснимков рис. 1 с коэффициентом сегментации равным 16.

Рис. 3. Результат выделения границ объектов на исходных фотоснимках

Для погружения объектов в виртуальное адаптационное пространство используются:

- операция классификации объектов на левом и правом изображении по признаку интенсивности цвета и площади объекта;

- операция экструзии объекта по направлению нормали относительно плоскости рисунка на расстояние оптического параллакса объектов.

На третьем этапе метода классификации объектов ВАП путем парного сопоставления объектов на левом и правом изображении и, исходя из технических характеристик сенсорных устройств (например, оптической силы линз мультимедийных сенсоров системы) вычисляется величина отношения размеров объектов окружающей реальности к размеру погруженных объектов в виртуальную реальность и информация о расстоянии отдаления от субъекта виртуальной реальности.

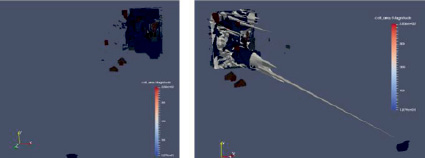

На рис. 4 представлен результат погружения объектов в виртуальное адаптационное пространство. Наиболее удаленный синий фрагмент сетки соответствует фрагменту штанги (R1 = 5.1), погруженной в виртуальное пространство. Коричневые фрагменты соответствуют нижним фрагментам стула (R2 = 1.7). Наиболее отдаленный синий фрагмент соответствует фрагменту стены (R3 = 1). Серый фрагмент на синем фоне соответствует фрагменту коробки 3D ручки R4 – 1,3. Максимальная величина абсолютной погрешности Ri для соответствующих объектов из таблицы составила 34 %.

Рис. 4. Результат погружения объектов в виртуальное адаптационное пространство

Рис. 5. Результат погружения объектов в виртуальное адаптационное пространство при увеличении коэффициента сегментации

На рис. 5 приведен результат погружения объектов в виртуальное адаптационное пространство при увеличении коэффициента сегментации изображения до 32. Белым слоем сетки на правом изображении отображена область интерполяции для карты высот объектов виртуальной реальности.

Значения обратного расстояния R для соответствующих объектов на рис. 5 равны фрагмент штанги (R1 = 7.1), фрагмент стула (R2 = 2.39), фрагмент стены (R3 = 1), фрагмент коробки 3D ручки (R4 = 2.52). Максимальная величина абсолютной погрешности Ri для соответствующих объектов из таблицы составила 31 %.

Результаты исследования и их обсуждение

В результате исследования было установлено, что метод классификации объектов виртуального адаптационного пространства применим к задачам выделения и погружения объектов. При увеличении сегментации изображения метод сохраняет устойчивость форм объектов. К недостатку метода можно отнести эффект слияния однотонных объектов при погружении их в виртуальное пространство.

Заключение

В статье был проведен анализ метода классификации объектов в виртуальном адаптационном пространстве. Представленный метод опирается на технологии погружения объектов в виртуальное адаптационное пространство, методы расчета оптического параллакса объектов и метод экструзии объектов. Из полученных результатов можно сделать вывод, что метод классификации объектов содержит погрешности при обработке однотонных объектов, которые способны нивелироваться при увеличении коэффициента сегментации изображения и изменении порога родственности близкотонных объектов.

Библиографическая ссылка

Дюпин В.Н. МЕТОД КЛАССИФИКАЦИИ ОБЪЕКТОВ ВИРТУАЛЬНОГО АДАПТАЦИОННОГО ПРОСТРАНСТВА // Современные наукоемкие технологии. 2021. № 5. С. 51-56;URL: https://top-technologies.ru/en/article/view?id=38657 (дата обращения: 14.05.2026).

DOI: https://doi.org/10.17513/snt.38657